画像があればなんでもできる、たとえ元気がなくとも。

2019年09月01日

こんにちは、M1の横山です。 最近(といっても最近ではない)ディープラーニングを使えばなんでもできそうな時代ですよね。そこで今回は世界中で行われているディープラーニングを用いた画像処理(Computer vision)の研究を少し見ていきたいと思います!

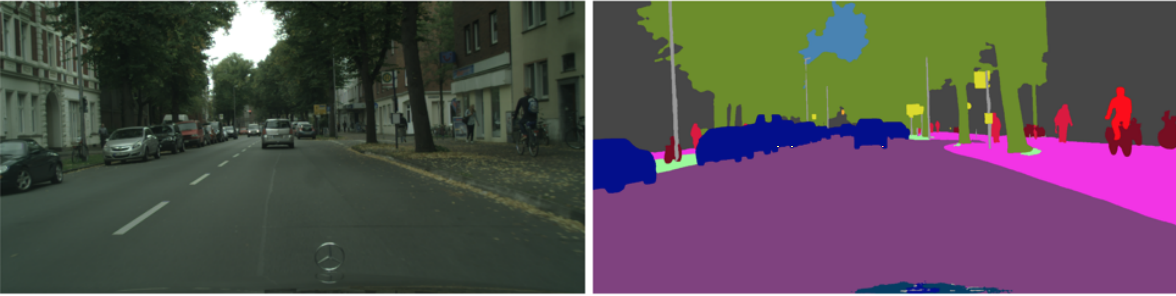

Image Segmentation

Segmentationとは画像に写っている人や車といったような物体を、それぞれで分割して認識することです。自動運転にも応用が期待される注目の技術です。  [Searching for Efficient Multi-Scale Architectures for Dense Image Prediction](https://arxiv.org/pdf/1809.04184v1.pdf)

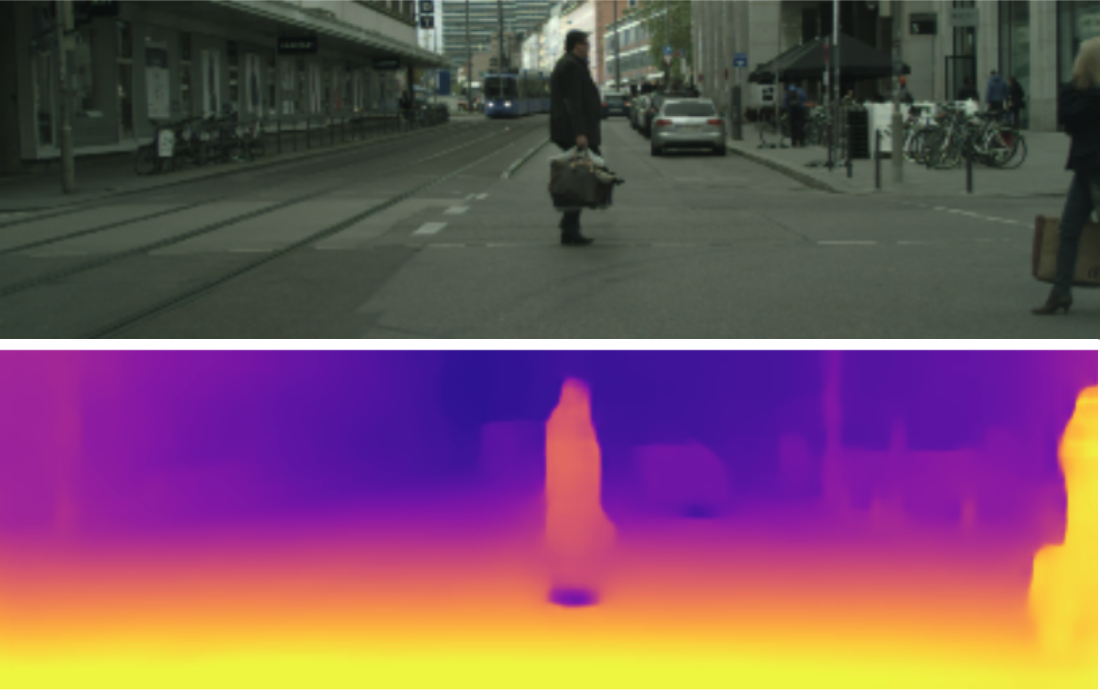

Depth and Egomotion Estimation

Depth Estimationは画像から深度情報つまり距離情報を推定することです。またEgomotion Estimationはカメラの動きの速さなどを推定することです。例えばロボットや自動車にカメラを取り付けて画像を撮り続けた時にいまどのくらいの速さで走っている?ということですね。  [Depth Prediction Without the Sensors: Leveraging Structure for Unsupervised Learning from Monocular Videos](https://arxiv.org/pdf/1811.06152.pdf)

2D Pose Estimation

2D Pose Estimationとは画像に写る人の骨格、関節を2次元において推定するものです。これは話題になったOpen Poseが有名かなと思います。  [Realtime Multi-Person 2D Pose Estimation using Part Affinity Fields](https://arxiv.org/pdf/1812.08008.pdf)

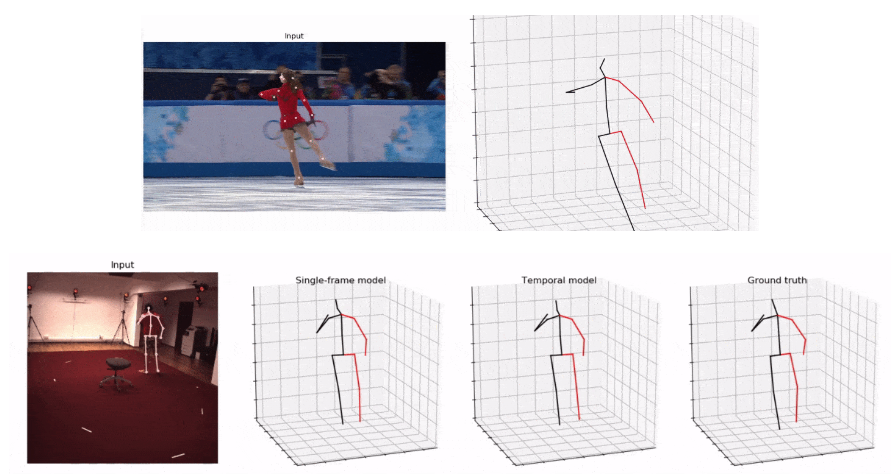

3D Pose Estimation

3D Pose Estimationとは前項で紹介した2次元の推定ではなく、文字通り3次元の座標において人骨格、関節を推定するものです。  [3D human pose estimation in video with temporal convolutions and semi-supervised training](https://arxiv.org/pdf/1811.11742.pdf)

おわりに

今回は世界中で行われている画像処理技術について少しばかり見ていきました。人間が目でみて判断する大抵のことはすでに現在の技術でできそうな気がしますね。これからも新しい技術の動向を追っていき、ロボット含む自分たちの研究にどう活かせるのかを考えていきたいです!